Big Data: Hadoop и экосистема больших данных

Анализ данных объемом в терабайты требует понимания не одной программы, а целой экосистемы распределенных систем. Здесь показывают, как объединить Hadoop, Spark, Kafka и NoSQL-базы в единую рабочую архитектуру, чтобы решать реальные бизнес-задачи.

Внутри разбирается установка и настройка Hadoop через Hortonworks/Ambari, написание сценариев обработки через Pig и Spark, а также интеграция потоковых данных с помощью Flink и Storm. Вы научитесь выбирать подходящую технологию хранения под конкретную задачу: от реляционных данных в Hive до неструктурированных в Cassandra или MongoDB.

Курс рассчитан на специалистов с базовым опытом программирования (Python или Scala) и пониманием командной строки Linux. Вы освоите проектирование распределенных систем и сможете управлять кластерами с помощью YARN, Mesos и Zookeeper.

Отзывов пока нет. Будьте первым!

Ещё интересные курсы

Можно купить

Можно купитьПродуктовая аналитика

GeekBrains Можно купить

Можно купитьИсследуйте в R

Анастасия БорейшаData Science на Python 3 с нуля

YouRa Allakhverdov Можно купить

Можно купитьМатемаркетинг 2020

МатемаркетингPython для статистического анализа

Samuel Hinton, Kirill Eremenko Можно купить

Можно купитьАналитик данных. Часть 5/6

Яндекс Практикум Можно купить

Можно купитьИнженер данных (Data Engineer). Часть 4/6

Яндекс Практикум Можно купить

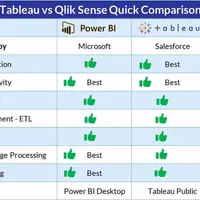

Можно купитьQlik Sense Certification - The Complete Practical Course

Paul Scotchford Можно купить

Можно купитьОсновы Python для исследований и анализа данных

И. Бибилов, К. Казанцев, А. Румянцева, В. Бабушкина Можно купить

Можно купить